对Claude Code移除TodoWrite 并引入TaskCreate机制的思考

在 2026 年 1 月 23 日,Anthropic 公司开发 Claude Code 的员工 Thariq 在 X 上发布了 We’re turning Todos into Tasks in Claude Code 这篇文章,详细地介绍了他们为什么移除 TodoWrite 并引入 Tasks 这个工具。 实际上,Claude Code 中已经有很多工具了,其中就存在 Task 工具,...

在 2026 年 1 月 23 日,Anthropic 公司开发 Claude Code 的员工 Thariq 在 X 上发布了 We’re turning Todos into Tasks in Claude Code 这篇文章,详细地介绍了他们为什么移除 TodoWrite 并引入 Tasks 这个工具。 实际上,Claude Code 中已经有很多工具了,其中就存在 Task 工具,...

Inno Setup for Visual Studio Code 这是一个为 Inno Setup 脚本提供全面支持的 VS Code 扩展。它包含了语法高亮、代码片段、悬停文档提示以及一键编译运行的集成环境。 主要特性 语法高亮:完整支持 .iss 脚本的语法着色。 代码片段:内置常用的 Inno Setup 段落(如 [Files], [Icons], [Run]...

Better Align for Visual Studio Code Better Align 是一款为 VS Code 设计的代码垂直对齐扩展。它能够智能地识别代码中的操作符并进行对齐,支持多种编程语言,无论是否选中代码都能高效工作。 主要特性 多语言支持:几乎支持所有主流编程语言。 智能对齐:支持自动识别代码块对齐,也可以对选中的区域进行对齐。 自定义配置:可...

前言 最近在cloudflare上购买了域名,有了域名之后配合VPS发现其实可以做很多有意思的事情,比如: Cloudflare 免费邮件转发 建立“私人短链接”系统 (Short URL) 造个人“数字名片盒” (Link-in-bio) 无限的“马甲邮件”转发 (Catch-all) 私人定制的“状态监控页” 我从这里面挑选了几个来搭建,还挺有意思的。这篇文章...

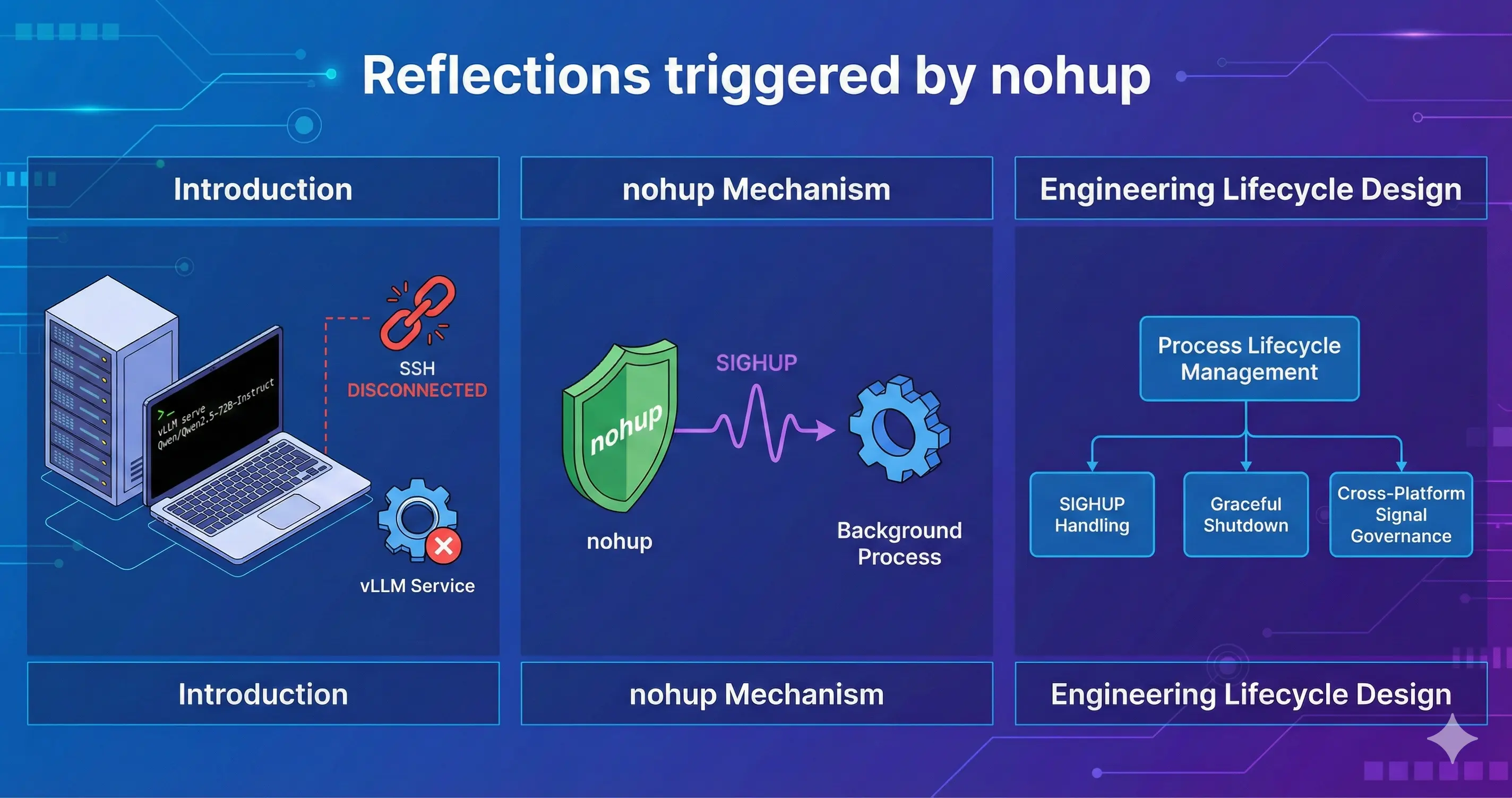

引言:从一次 vLLM 掉线谈起 最近在公司的 8 卡 L40S 服务器上部署大模型推理服务(以 Qwen2.5-72B-Instruct 为例)时,我采用了常见的启动方式: vllm serve Qwen/Qwen2.5-72B-Instruct ... & 服务跑了一会儿,我关闭了 Windows Terminal。重新登录后发现模型服务也停了。排查下来原因很直接:即便加了...

背景 在企业内部部署 vLLM 提供大模型推理服务时,如果直接把服务端口暴露在内网,往往会遇到下面这些“裸奔”问题: 无权限控制:API 地址一旦泄露,任何人都能调用,GPU 资源容易被滥用。 无流量限制:某个脚本写了个死循环,瞬间把显卡打满,其他同事的任务直接被拖垮。 无监控审计:不知道是谁用了多少 Token,很难做成本核算和容量规划。 协议兼容性差:希望完全兼容 ...

什么是webpack,为什么有webpack,webpack能解决什么问题

本文通过分析 Claude Code 在回答一个”介绍 l2topo 组件拓扑计算算法”问题时的 32 轮内部对话,深入揭示了其背后的多 agent 协作机制和系统设计原理。研究发现,Claude Code 采用了”多阶段任务流水线”的架构模式,通过主题识别、任务规划、代码探索、算法分析和结果整合五个阶段,将复杂的代码分析任务分解为可执行的子环节。通过精心设计的工具体系和权限控制,让 LLM...

LeetCode中解决问题讨论技巧 🧠 一、暴力枚举(Brute Force) 特点:直接枚举所有可能性,逐个检查是否满足条件。 适用场景:数据量较小时,作为初步思考方向或对数值范围明确时可用。 典型题目:两数之和、全排列。 🔁 二、双指针(Two Pointers) 常见形式: 快慢指针(判断链表是否有环) 左...

Tree-Sitter 解析 C 语言的工作原理 1. Tree-Sitter 的核心设计 Tree-Sitter 的核心是一个确定性有限自动机 (DFA) 和解析表的组合。它通过以下流程实现高效的语法解析: 语法定义:每种语言的语法规则通过 JSON 或 JavaScript DSL 定义。 解析器生成:Tree-Sitter 根据语法规则自动生成高效的解析器。 增量解...